如果你看過《Lie to me》這部美劇,就不會對“透過辨別微表情指認犯罪者”這個設定感到新奇。

事實上,自從人類發明攝影術以后,學術界與人工智能界就正式開啟了關于“如何通過面部識別技術來確認罪犯”的腦洞:

攝影時代的到來曾讓一部分19世紀科學家堅信,機器絕對有能力通過識別人的面部特征來準確找到罪犯。雖然他們這種最終被打上了“不可信”與“荒謬”的標簽,但200年以后,這一曾經的“謬論”卻可能為他們挽回聲譽:

新一代人工智能技術或許可以證明他們的言論是有據可查的。

上海交大:神經網絡識別犯人的精準度高達89.5%

在中國,來自上海交通大學的研究員吳小林與張希讓這個極具爭議的傳統型議題——“通過面部識別確認罪犯”再次回歸大眾視野:

他們建立了一個據說只需通過驗證面部特征就可找出犯人的神經網絡。

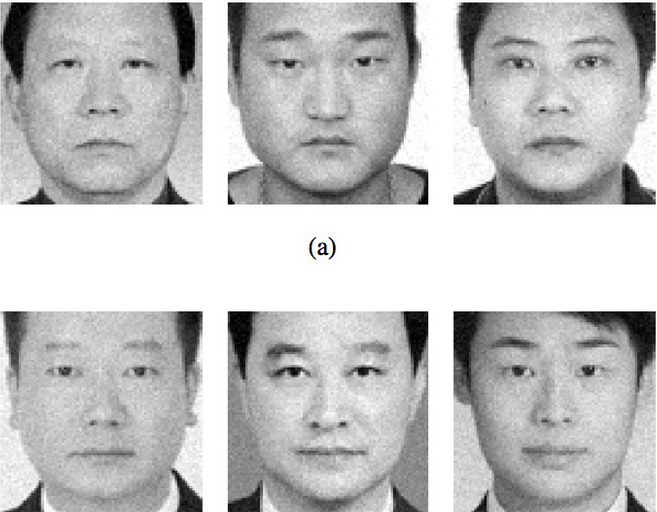

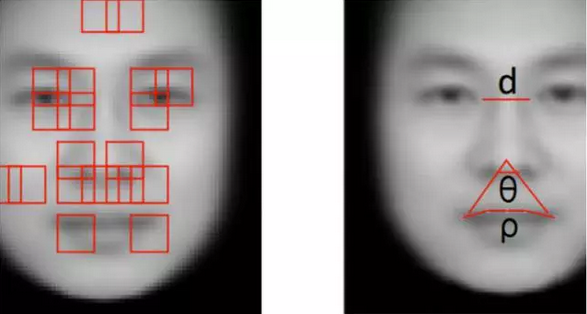

在他們的論文中,為了證明這個理論的可行性,研究員們將大量嫌疑犯與未犯罪者照片混放在一起,繼而利用大量機器視覺算法來測試這些人的面部表情,目標就是發掘出一套能夠可靠分辨出犯人的神經網絡系統。

在這個過程中,科學家需要將1856張無面部毛發(包括眉毛、嘴毛以及胡須等等)、年齡在18~56歲之間的中國人照片灌輸給神經網絡。這些照片中的一半人(約有730張已被確認為犯罪者)具有犯罪前科。

值得注意的是,研究員只用其中的90%來訓練人工智能以識別犯人與普通人之間的差異,其余10%用來檢測這套系統的目標達成度。

而成果的確令人印象深刻。根據研究人員提供的數據,這套神經網絡區分犯人與普通人的精準度高達89.5%。因此,吳小林與張希也認為:

“即便‘通過面部表情推測罪犯’是一個歷史爭論,但這些與事實高度匹配的結果的確是一個很好的證據。”

研究結果與MIT科技評論此前給出的解釋非常類似,神經網絡識別面部特征的要素可以被劃分為三個類別:

?犯人上唇的彎曲度會比普通人平均高出23%;

?犯人雙眼內眼角之間的距離比普通人窄6%;

?犯人的鼻尖與嘴角之間形成的角度比普通人小20%。

不過上海交大的研究員們還得出了一個更有意思的結論:與普通人相比,犯罪者之間的面部表情往往呈現出更大的差異。

“換句話說,比起罪犯們的臉,普通大眾的臉有更高的相似度;而犯人之間的面容比普通人有更大的差異度。”

實際上,上海交大的研究結果很難引起人工智能界的驚訝:這個準確率極高的結果根本不值得大驚小怪。

此前學術界就指出,如果“犯罪心理學家”的存在是對“人類有能力分辨出犯人與普通人”的最好證明,那么機器也應該有能力這么做——畢竟神經網絡系統就是對人類大腦的最好模仿。

人工智能在面部識別應用領域的技術與道德局限:

然而,這項特殊研究的主要方法還不能獲得足夠信任,原因就在于研究所選取的各項參數還存在諸多問題。

譬如用于訓練神經網絡的照片樣本是嚴重受限的(只有1000多份)。或者至少可以這么說,研究結果在很大程度上取決于照片的質量與數量。

因此,這個研究成果一公布,就毫不意外地引起網友的擔憂與譴責:

照這么說,人們無意中翹起的嘴角,嘴巴的大小與形狀,拍攝照片的角度都會讓一個人變得“賊眉鼠眼”。因此,研究結果所謂的科學依據與可靠性僅僅是人工智能技術的“一廂情愿”。

而MIT科技評論也認為,這項人工智能技術引起的最大擔憂其實在于,計算機很可能在人類法庭上根據一個人的面相,帶有偏見來指證一個無辜的人。與此同時,一個看起來很無辜的犯人也有可能被機器證明“無罪”而逍遙法外。

實際上,就像文章開頭所說的,對此類研究的大肆譴責一直延續了幾十年甚至上百年。

譬如今年9月,在一項名為Beauty.AI的選美大賽上,由 6 名 AI 機器人擔任評委。這些機器人利用 5 種算法對來自全球年齡在18-69歲的自拍照片進行了評判。

但選美結果卻遭到了很大的非議——因為機器人根本“不喜歡”皮膚黑的人,幾乎所有黑皮膚的照片都被機器篩掉了。

所以說,這種帶有“種族歧視”的結果再一次讓基于人工智能的面部識別技術陷入尷尬的境地。

因此,就像Beauty.AI選美大賽首席技術官Alex Zhavoronkov給出的解釋一樣,對神經網絡進行充足的訓練是將人工智能推入應用層的前提:

“如果在你采集的數據庫中沒有足夠多不同膚色的照片可以參考,那么人工智能機器人注定會產生有偏見的結果。”

或許我們不能質疑,未來某一天,除了完美打破各項成功紀錄,人工智能技術將有足夠能力執行各種基于面部識別的任務。

但是,我們卻不能排除另一個潛在的安全威脅:那些被機器打上“無害”標簽的普通人真的不會給我們帶來威脅嗎?在這項技術足夠成熟后,如何鑒別那些能夠進行完美“反偵查”的“偽裝者”?

或許這些理由就是我們不能對人工智能識別技術掉以輕心的根本原因。